专访高通高级副总裁:年内可支持100亿参数大模型在手机上运算

·“100亿-150亿参数级别的模型可以覆盖绝大多数生成式AI的用例。如果终端已经可以支持这一参数级别,那么运算可全部在终端上进行,无需云端处理运算。届时我们会拥有非常丰富的使用场景,手机会成为您真正的个人助理。”

大模型和生成式AI在公众的印象中,仍然是大算力和大功耗的代表,但实际上,完全断网的飞行模式下,在手机上离线运行大模型已经成为现实。

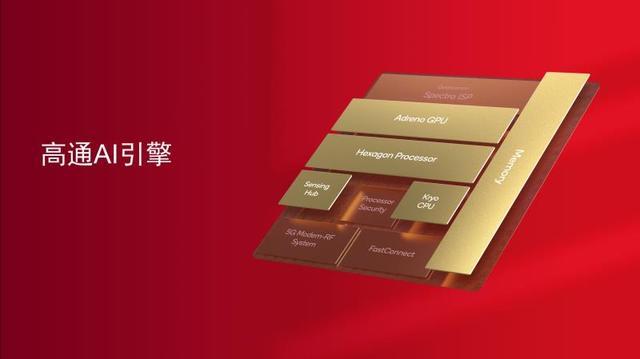

高通AI引擎由多个硬件和软件组件组成,用于在骁龙移动平台上为终端侧AI推理加速。它采用异构计算架构,包括高通Hexagon处理器、AdrenoGPU、KryoCPU和传感器中枢,共同支持在终端上运行AI应用程序。上图为第二代骁龙8移动平台的高通AI引擎。

在2023年世界人工智能大会上,高通技术公司(Qualcomm)展示了全球首个在终端侧运行生成式AI(AIGC)模型StableDiffusion的技术演示,和全球最快的终端侧语言-视觉模型(LVM)ControlNet运行演示。这两款模型的参数量已经达到10亿-15亿,仅在十几秒内就能够完成一系列推理,根据输入的文字或图片生成全新的AI图像。

在接受澎湃科技(www.thepaper.cn)专访时,高通技术公司产品管理高级副总裁兼AI负责人ZiadAsghar进一步表示,“本年度我们将能够支持参数达100亿的生成式AI模型在手机上运行,这意味着未来大多数的用例将能够完全依靠手机端就能够完成。我们在技术层面已经做好了准备。”

生成式AI进入未来生活的趋势已经不可阻挡,为了让生成式AI规模化扩展到更多终端设备中,高通提出了混合AI架构的运行方式,即在云端和设备终端的边缘侧之间分配算力,协同处理AI工作负载。近期发布的白皮书《混合AI是AI的未来》中,高通也提到“在以终端为中心的混合式AI架构中,云端仅用于处理终端侧无法充分运行的AI任务。”

5G技术的广泛应用让从中心云、到边缘云、再到终端侧的信息得以无缝传输和协同计算。Asghar表示,在数据产生的地方直接进行高效推理才是大趋势。而数据产生的地方正是在端侧,比如手机端或电脑端。在高通AI软件栈(QualcommAIStack)的帮助下,手机端的能力更是可以在其他设备端实现复制,如PC、AR/VR、汽车和物联网IoT设备。

手机上的长期技术优势

高通在手机处理器芯片中的地位毋庸置疑,当国内外手机品牌比拼技术参数时,都会以搭载高通骁龙处理器作为卖点。此次高通对混合AI技术路线的提出,让人自然联想到高通在手机上的优势。对此,Asghar也向澎湃科技直言,“高通支持生成式AI在终端侧进行推理,是因为我们完全有能力支持在手机上进行10亿、15亿甚至未来上百亿参数规模的模型运算。”

“100亿-150亿参数级别的模型可以覆盖绝大多数生成式AI的用例。”Asghar介绍,“如果终端已经可以支持这一参数级别,那么运算可全部在终端上进行,无需云端处理运算。届时我们会拥有非常丰富的使用场景,手机会成为您真正的个人助理,与手机交流和交互,能够成为我们日常行为的自然延伸,如用于预约会议、写邮件,以及在娱乐和内容生产上。”

希望在终端侧进行生成式AI的运算,最首要的原因是隐私保护。如果要通过云端进行生成式AI的查询,用户输入和查询的相关信息也会传送到云端,从而造成潜在的安全风险。与之相对,在端侧通过生成式AI进行查询的话,所有信息都能够保留在端侧。另外,终端侧的运算会带有丰富的情境信息,如手机和VR/AR(虚拟现实/混合现实)设备上,消费者本人的移动状态、个人偏好,设备上的多媒体信息等都可以被生成式AI捕捉,带来比云端更好的沉浸式体验。

要在终端侧支持100亿-150亿参数的AI大模型,需要非常强大的终端侧AI技术和算力支持。Asghar介绍,终端设备每年在性能上都有长足的进步,这主要是因为高通在许多芯片模块上都实现了技术迭代,比如CPU、GPU和Hexagon处理器(高通的AI专用处理器)。

“高通的DNA是以低功耗实现高性能,这是我们在所有产品设计研发方面的宗旨,AI计算更是这样。”Asghar提到StableDiffusion的运算时进一步表示,“StableDiffusion如果通过云端计算,需要几百瓦的功率,但在高通芯片组的支持下,在终端设备能够实现仅毫瓦级别的功耗,这是高通最大的竞争优势之一。”

将技术优势拓展到其他终端

实际上,高通在手机上的先进技术在其他设备端也实现了复制,比如在汽车领域,高通的汽车ADAS应用同样做到了更低功耗。Asghar介绍,高通有些产品线的AI性能比其他产品线更高,“比如汽车平台,因为汽车芯片的尺寸更大,可以支持更高算力,PC平台也是同理。”

“在高通,我们有‘统一的技术路线图’,它包括一系列高通独特的知识产权和技术,是高通不同业务解决方案的核心。我们可以将这些核心技术广泛扩展到不同的产品线。”Asghar介绍,“同样的Hexagon处理器和高通AI软件栈,可以应用于我们全部的业务线,包括手机以及AR、VR等终端。”

在AI计算的实现上,软件与硬件同样重要,因为必须在端侧做到运算更快,效率更高,并推动AI应用在广泛终端上的部署和普及。这也是2022年6月高通推出高通AI软件栈(QualcommAIStack)的原因。高通AI软件栈支持包括TensorFlow、Pytorch和ONNX在内的所有主流开发框架,所有runtimes(运行时,即某门编程语言的运行环境)和操作系统。借助高通AI软件栈,开发者在智能手机领域开发的软件可以快速扩展至汽车、XR、可穿戴设备等其他产品线进行使用。

高通AI软件栈这种一次开发就能全面部署所有产品线的优势,也为高通打造生态圈奠定了基础。基于高通分布于各个领域的知识产权和技术,高通能够横跨多个生态系统,与行业领军企业进行深入合作,例如在PC领域,2023年5月微软Build大会上,高通和微软宣布合作关系,将面向消费级和企业级终端规模化扩展AI能力。在AR/VR终端方面,2022年9月,高通也与Meta进行了合作,为MetaQuest平台提供定制骁龙XR平台。

“未来我们需要加大终端侧技术上的研发,尤其是进一步提升量化的算法。例如服务器上训练的模型一般采用32位浮点运算(FP32),而我们在手机端现在能够支持INT4计算,这能大大提高端侧的处理能力。”Asghar说。