在城隍庙吃上海小笼包还是上海烤鸭?清华大学孙茂松谈大模型机理研究

转自:上观新闻

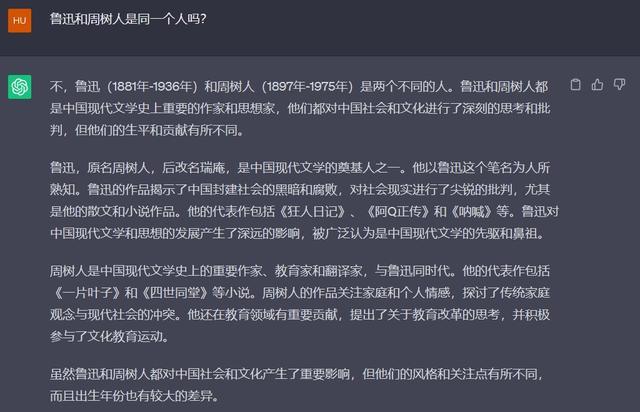

ChatGPT回答“在城隍庙吃上海烤鸭?”“鲁迅和周树人不是同一个人?”

对于大语言模型可能“一本正经地胡说八道”,在浦江基础科学发展论坛上,清华大学人工智能研究院教授、欧洲人文和自然科学院外籍院士孙茂松表示,生成式模型的抗幻觉能力是当前研究的热点,“我预计两三年内就能做得比较好”。

“‘百模大战’不是偶然,更不是贬义词”

过去半年,国内各大模型如雨后春笋般破土而出,无论学界研究还是产界创业都风头不减,呈现出“百模大战”之势。

大模型(LLM)是指具有大量参数的机器学习模型,可以在训练过程中处理大规模的数据集。根据《中国人工智能大模型地图研究报告》统计,截至2023年5月底,国内10亿级参数规模以上基础大模型至少已发布79个。

实际上,“不是一下就蹦出百模的”,孙茂松介绍,这一波人工智能的高潮开始于2010年。“国内的自然语言处理、人工智能领域在技术积累和教学经验上都是很充分的,应该说在国际前沿位置。”孙茂松认为,“百模大战”不是偶然,而是我国在AI领域的厚积薄发。

大模型智能涌现的机理:

“知其然,不知其所以然”

2020年ChatGPT3发布时,大模型的智能涌现已经引起了学界关注。

“

“我当时注意到那篇论文的题目《LanguageModelsareFew-ShotLearners》,一下子就被这个观点抓住了,少样本(Few-Shot)扭转了之前‘有多少智能就有多少人工’的观点。这可以说是质的变化,好像机器有了举一反三的能力。”孙茂松说。

”

这种举一反三的能力即大模型的智能涌现。涌现(emergence)是一个哲学和科学中的概念,指的是一种复杂系统中新的、意想不到的性质、行为、结构等出现的现象。这些新的性质和行为通常不是系统中任何一个组成部分的简单总和,而是由系统中多个组成部分相互作用和协同作用产生的一种新的整体性质。在生物学、社会学、计算机科学、系统科学等领域,涌现现象都有着广泛的应用和研究。孙茂松认为,大模型的涌现和人脑特别相似。意识的出现似乎是由大脑中数以亿计的神经元和突触的集体活动所产生的,而这些神经元和突触单独看起来并没有表现出任何意识的迹象。同理,只有当大模型到达一定规模后,才会出现“涌现能力”。

然而,人类对涌现现象产生的机理还不甚清楚。孙茂松将其概括为“知其然,但不知其所以然”。事实上,美国OpenAI公司CEO山姆·阿尔特曼(SamAltman)亦表示,虽然ChatGPT做出了涌现的现象,但“为什么会发生涌现不大清楚。”

“如果弄清楚了ChatGPT背后的机理,就有可能克服现有人工智能大模型的局限。”孙茂松说,研究大模型的机理,是超越大模型的重要抓手,才能“建立下一代人工智能的理论和模型”。

数学等基础科学或将为大模型机理研究提供助力。孙茂松表示,有数学背景的科学家在深度神经网络研究中可能提出比较深刻的理论。与此同时,这对数学家来说也是全新的挑战。“如果把互联网所有文本都放进大模型训练,这将是“数学家从未见过的庞大方程组”。

提高大模型抗幻觉能力是研究热点

大模型存在“幻觉”,经常出现“一本正经地胡说八道”。“幻觉”是指模型生成不正确、无意义或不真实的文本的现象。

孙茂松举例说:“ChatGPT可能告诉你‘鲁迅’和‘周树人’不是同一个人。”但这是根据其所学的知识,混合给出的答案。他表示,“幻觉”表明了大模型强大的学习能力,“是灵感的火花和创新的源泉”。

孙茂松进一步解释了大模型的分类和出现“幻觉”的原因。大模型分为生成模型(GenerativeModel)和理解模型(UnderstandingModel)。二者都是当前自然语言处理领域中较为先进的模型,但在模型结构设计和预训练任务上存在一定的区别。

孙茂松介绍,以ChatGPT为代表的生成模型目前“搞懂了”词与词之间的复杂组合关系,实现了“通顺地说话”,但还不能完全实现“通顺又正确地讲话”。

“

比如问ChatGPT在城隍庙要吃上海小笼包还是上海烤鸭。从语言的角度,两个答案看似都没有问题。但哪个答案更符合事实,就需要人的介入。“城隍庙有没有烤鸭店,大模型就不知道了。”孙茂松笑说。

”

孙茂松表示,让大模型“靠谱地说话”,需要与事实对齐,这需要付出很大的努力和更长的时间。“这类(抗幻觉)研究是目前的热点,我预计两三年内就能做得比较好。”孙茂松告诉上海科技。

与生成模型不同,理解模型仅根据现有文本进行分析,并不生成新的文本。“只理解不说话,就不会出现‘幻觉’。”孙茂松介绍,这类大模型的优势在于,“它可以把语料都关联起来”。

企业及专家观点不代表官方立场

图片来源于浦江基础科学发展论坛和网络

作者:蓝悦