速递|刚刚,OpenAI 发布了高级语音模式!

周二,OpenAI宣布向更多ChatGPT付费用户推出“高级语音模式”(AdvancedVoiceMode,简称AVM)。

目前,OpenAI提供了两种类型的语音对话——标准语音和高级语音:

1)高级语音:目前正在向Plus和Team用户逐步推出。该功能使用GPT-4o的原生音频技术,能够实现更加自然的实时对话,并捕捉非语言线索(例如语速),还能作出情感化的回应。

Plus和Team用户每天对高级语音的使用量有限制,包括语音输入和输出。企业版和教育版的用户将在下周开始获得该功能。

2)标准语音:适用于所有登录ChatGPT的用户,并可以通过iOS、macOS和Android应用使用。

标准语音通过多种模型生成响应,包括将语音转录为文本,再传递给模型进行回答。

尽管标准语音不像高级语音那样具备原生多模式功能,但它仍然使用GPT-4o和GPT-4omini。需要注意的是,标准语音中的每一次提示都会计入消息限制。

要开始语音对话,需要选择屏幕右下角的“语音”图标:

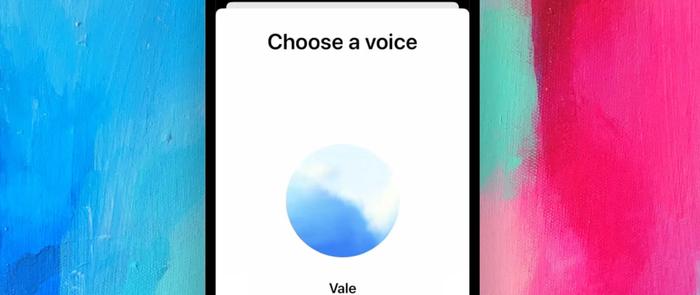

当开始高级语音对话时,用户将被带到一个屏幕,屏幕中心有一个蓝色球体:

AVM将在一周内逐步向所有Plus和Team用户推送。在等待期间,OpenAI还增加了“自定义指令”、记忆功能、五种新语音和改进的口音支持,还可以用超过50种语言说“抱歉,我迟到了”。

此外,ChatGPT还新增了五种可供用户体验的语音:Arbor、Maple、Sol、Spruce和Vale,加上之前的Breeze、Juniper、Cove和Ember,ChatGPT语音总数达到了九种,几乎赶上了谷歌GeminiLive的数量。

Arbor-随和且多功能

Breeze-生动活泼

Cove-沉着且直接

Ember——自信而乐观

Juniper –开放而乐观

Maple——开朗、坦诚

Sol-精明且放松

Spruce——冷静而肯定

Vale——聪明且好奇

OpenAI表示,自从AVM的有限alpha测试发布以来,已经进行了多项改进。据称ChatGPT的语音功能现在对口音的理解能力更强,且对话更加顺畅和迅速。

OpenAI还将ChatGPT部分定制功能扩展到了AVM,包括“自定义指令”,允许用户个性化ChatGPT的响应方式,以及“记忆功能”,让ChatGPT能够记住之前的对话以供以后参考。